こんにちは。

株式会社エス・スリーのスタッフです。

本日は「ONEXPLAYER2でstable diffusionを試す」という内容の記事です。

※手順の解説記事ではありません

2022年のstable diffusionが出たての頃にも一度記事にしましたが、生成AIの進化が目覚ましく、過去とは比べ物にならない画像が出力できるようです。

話題の画像生成AI!stable diffusion

今回は、筆者の私物のONEXPLAYER2で生成を試してみることにしました。

ポータブルゲーミングPCです。

collabで動かすのも良いのですが、コンピューティング ユニット100単位を購入したもののすぐに使い切ってしまったので、

ローカルで思う存分動かしたいなと思い、手持ちのPCで比較的容量に余裕があり、GPUも積んでいるという理由でONEXPLAYER2を選びました。

しかし、いきなり問題があります。

ONEXPLAYER2のGPUはAMDですが、よく使われて人気がある、stable_diffusion_webuiはnvidiaのGPUが必要なのです。

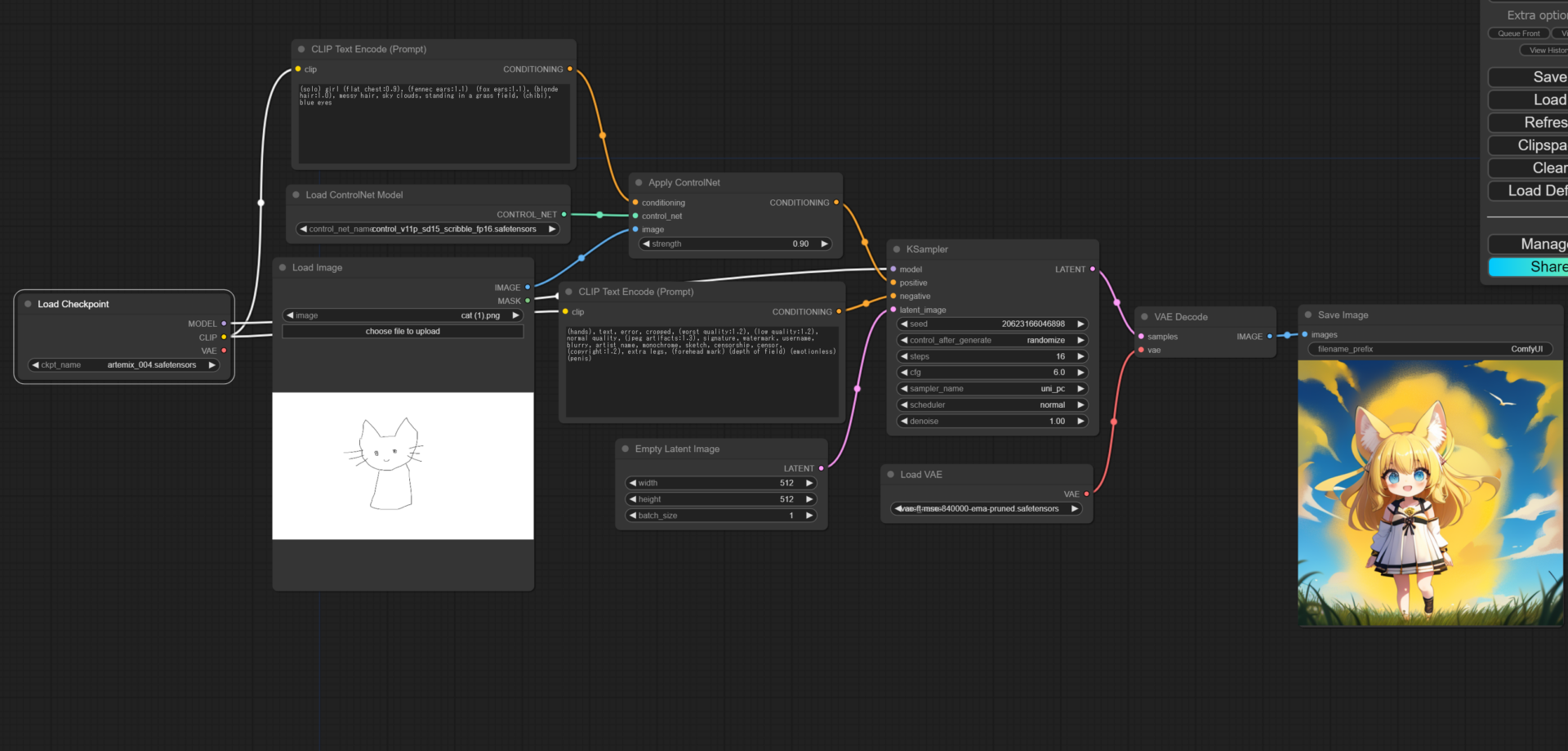

AMDでstable diffusionを動かすには…?と検索していたところ、stable_diffusionのWEBUIのほかに、ComfyUIというWEBUIがあることが分かり、スクリーンショットも分かりやすそうだったので、こちらを試してみることにしました。

「comfyui windows」などで検索するとインストール方法は沢山でてきます。

今回はcontrolnetも導入して、手書きのスケッチから生成を試してみました。

ComfyUIの公式サイトのワークフローの画像を、自分のブラウザのComfyUIにドラッグ&ドロップするとそのワークフローを試すことができます。

※ワークフローで使用しているモデルやVAEは別途インストールが必要です。

一応適当な猫のスケッチから、可愛らしい猫少女が生成できました。

ただ、結構時間はかかってしまい、80秒~90秒といったところです。

といっても料金を気にせずローカル環境で色々試せるのは楽しいですね。

最後までお読みいただき、ありがとうございます。